AnthropicがCoreWeaveとマルチイヤー契約、Vera Rubin GPU確保と独立クラウド戦略の本気度

2026年4月10日の発表を受けて、CoreWeaveの株価は+11%超を記録した。CNBCが「前日のMeta $21億契約に続く連続受注」と報じたのは、単なる株価ニュースではなく、AI計算インフラをめぐる勢力図が短期間で急変していることを端的に示すシグナルだと思っている。

独立系GPUクラウドというカテゴリが存在したことは5年前に誰が想像しただろうか。それが今や、OpenAI・Meta・Anthropicという大手AIラボの調達リストに並ぶ名前になった。

何が発表されたか

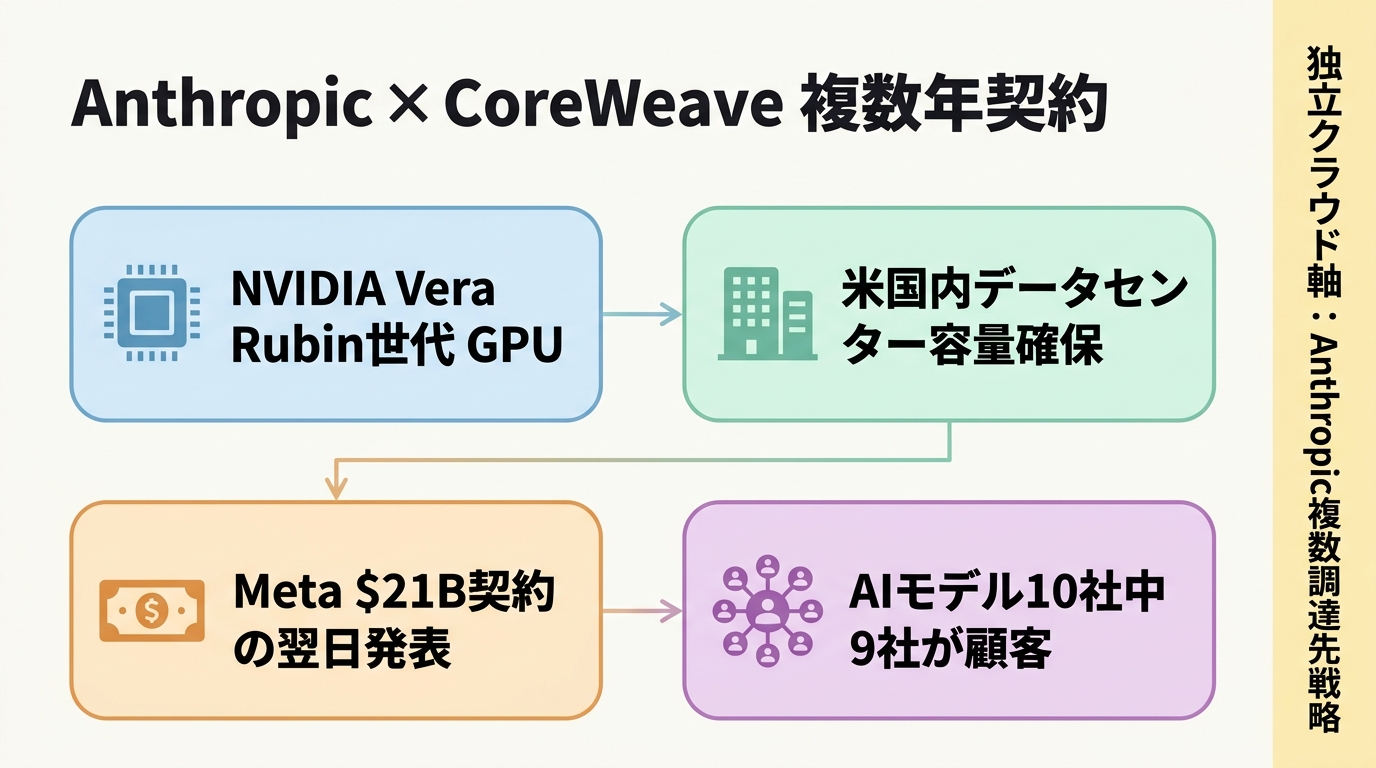

CoreWeaveが公表したのは、Anthropicとのマルチイヤー(複数年)データセンター容量契約だ。具体的な金額は非公開だが、対象となるのはNVIDIAの次世代アーキテクチャ「Vera Rubin」世代のGPUを含む米国内のデータセンターリソースとされている。

Vera RubinはNVIDIAがBlackwellの後継として開発中のGPUアーキテクチャで、AI学習・推論向けに大幅なスループット向上が見込まれている。現時点でNVIDIAがサンプル出荷を開始した段階にあり、大規模展開は2026年後半から2027年にかけてと予測されている。つまりAnthropicはこの発表時点で、まだ市場に出回っていない次世代GPU容量を先行確保したことになる。

契約の内容は「容量確保(reserved capacity)」という形式を取る。AnthropicがCoreWeaveのデータセンターに自社モデルの学習・推論ワークロードを移す際に使えるリソースを、事前コミットメントで抑える仕組みだ。データセンターの所有権はCoreWeaveが持ち、Anthropicはその上でインフラを「借りて使う」形になる。

なぜ CoreWeave なのか

「なぜAWSやGoogleではなく、CoreWeaveなのか」——これが今回の発表で最も興味深い問いだ。

CoreWeaveはニュージャージー州に本社を置く独立系GPUクラウドプロバイダーで、当初は仮想通貨マイニング向けにGPUファームを運営していたが、AI需要の急増を受けてAI特化のクラウドサービスへと事業転換を果たした。2024年のNASDAQ上場以来、企業価値は急上昇しており、現在のAI業界では欠かせないインフラレイヤーの一角を担っている。

CoreWeaveの最大の強みは、NVIDIAとの深い協業関係だ。同社はNVIDIAから優先的にGPUを調達する立場にあり、Vera Rubin世代についても早期アクセスの枠を確保していると報告されている。超大型クラウド(ハイパースケーラー)がAI独自アクセラレータ(Google TPU、AWS Trainium等)の開発に力を入れる中、CoreWeaveはNVIDIA GPUに特化した純粋なGPUクラウドとして独自ポジションを確立している。

顧客基盤の広さも見逃せない。CoreWeaveはAIモデルプロバイダー上位10社のうち9社を顧客として抱えているとされる。OpenAI、Meta、Mistral、そして今回のAnthropicと、業界をリードするプレイヤーのほぼ全員がCoreWeaveを利用している計算になる。「競合のリソースを同じ会社から借りている」という奇妙な構造が、AIインフラ業界の現実だ。

Anthropicの複数調達先戦略の中での位置付け

今回の契約を単独で読むと「Anthropicがデータセンターリソースを増やした」という話に見えるが、ここ数週間の動きを並べると、もっと大きな戦略の輪郭が浮かび上がってくる。

4月6〜7日、AnthropicはGoogle・Broadcomと組み、3.5GW相当の次世代TPU処理能力を確保する大型コンピュート契約を発表した(詳細は「ARR $30BでAnthropicがOpenAIを抜いた 3.5GWコンピュート確保が示す次の賭け」参照)。あの契約はTPU(Googleの独自AIアクセラレータ)が対象だった。

今回のCoreWeave契約はNVIDIA GPU、しかも独立系クラウド経由だ。

Anthropicは意図的に調達先を分散させている。Google系TPUと、NVIDIA GPU(CoreWeave経由)という異なるアーキテクチャ・異なるサプライチェーンを並走させることで、特定ベンダーや特定技術への依存を避ける。コンピュート調達の「ポートフォリオ戦略」と呼んでいい。

この戦略には実務上の理由もある。GPU/TPUの供給は今も逼迫しており、単一サプライヤーに依存した場合のリスクは小さくない。また学習ワークロードと推論ワークロードでは最適なハードウェアが異なるケースもあり、複数のアーキテクチャへのアクセスを確保しておくことは、運用の柔軟性を高める。

独立系クラウドを活用する意義として、CoreWeave CFOのNeeral Shah氏が指摘しているのが「ハイパースケーラーとの非競合性」だ。AnthropicはAWS、Google Cloud、Azure上でモデルを提供する立場にある。そのAnthropicが特定の大型クラウドのデータセンターに依存しすぎると、ビジネス上の利益相反が生まれる可能性がある。CoreWeaveはそうした利害関係のない、純粋なインフラプロバイダーとして機能する。

Meta $21億契約との関係——連続発表の意味

Anthropicの発表は4月10日。CoreWeaveとMetaの$21億契約発表の翌日にあたる。

この「翌日」という事実をどう読むかは難しいが、少なくとも偶然ではないだろう。CoreWeaveにとって、Metaという世界最大クラスのAI投資家との大型契約発表の直後にAnthropicとの追加契約を公表することは、「AIトップラボからの信任状」を市場に見せる絶好のタイミングだ。CoreWeaveは2024年のIPO以降、資本市場への存在感アピールを意識的に行っており、今回の発表タイミングはその文脈で理解できる。

Metaとの$21億契約は規模感として先行するが、Anthropicとの契約は「Claude系モデルの学習・推論基盤を独立クラウドが支える」という質的な意味を持つ。Claudeは企業向けAIとして現在最も急成長している製品群の一つであり、そのコンピュートの一部を担うことは、CoreWeaveのブランド価値を技術的な信頼という軸で強化する。

業界へのインパクト——コンピュートの「公益事業化」

今回の契約が示す構造変化として、コンピュートインフラの「公益事業(utility)化」がある。

かつてコンピュートリソースはクラウド大手が一括管理するものだったが、AIの台頭によってGPUクラスターという特殊資産の調達が戦略的優位に直結するようになった。その結果、CoreWeaveのような「GPU特化のインフラ専業」が市場に成立し、複数のAIラボが同じプロバイダーからリソースを調達するという構造が生まれた。

電気や通信が特定の事業者に独占されず、複数プロバイダーから調達するように、AIコンピュートも「インフラとして調達するもの」として成熟しつつある。CoreWeaveが10社中9社を顧客として持つということは、そのインフラが実質的に業界標準の一部として機能し始めていることを意味する。

この流れは規制の視点からも見逃せない。EUや米国政府がAIのコンピュートアクセスをめぐる競争政策の議論を進める中、特定の大型クラウドへの集中度を下げる動きは、政策的にも整合性がある。独立系GPUクラウドの存在は、AI産業のコンピュート層における多様性を担保する構造として機能しうる。

まとめ

Anthropicは短期間でTPU(Google系)とGPU(CoreWeave経由のNVIDIA)という異なる調達軸を同時に確保した。資金調達の規模だけでなく、コンピュートの質と分散という観点での先手を打ちにいっている。

CoreWeaveにとっては、IPO後の市場での信任を積み上げるうえで重要な契約だ。AIモデルプロバイダー上位10社中9社という顧客基盤は、独立系GPUクラウドというカテゴリの存在価値そのものを証明するものだ。

Vera Rubin世代のGPUが本格展開される2027年以降、この契約がAnthropicのモデル世代交代にどう貢献するかが、真の評価ポイントになる。その頃には、「CoreWeave経由で何をトレーニングしたか」が問われることになるはずだ。

関連記事

- ARR $30BでAnthropicがOpenAIを抜いた 3.5GWコンピュート確保が示す次の賭け

- Claude CoworkがエンタープライズGAへ——営業・法務・財務が使うAIエージェント時代の始まり

- Oracle、3万人解雇でAIインフラに賭ける——利益95%増でも「人を切る」理由