AIエージェントをゼロから運用できる時代が来た——Anthropic「Claude Managed Agents」公開ベータの全貌

「Rakutenが1週間以内でエージェントをデプロイした」——この一文を読んで、筆者は少し立ち止まった。大企業がAIエージェントを本番稼働させるには、インフラ設計、スケーリング設定、セッション管理の実装に数ヶ月かかるのが普通だったはずだ。それが1週間。何かが根本的に変わったのかもしれない。

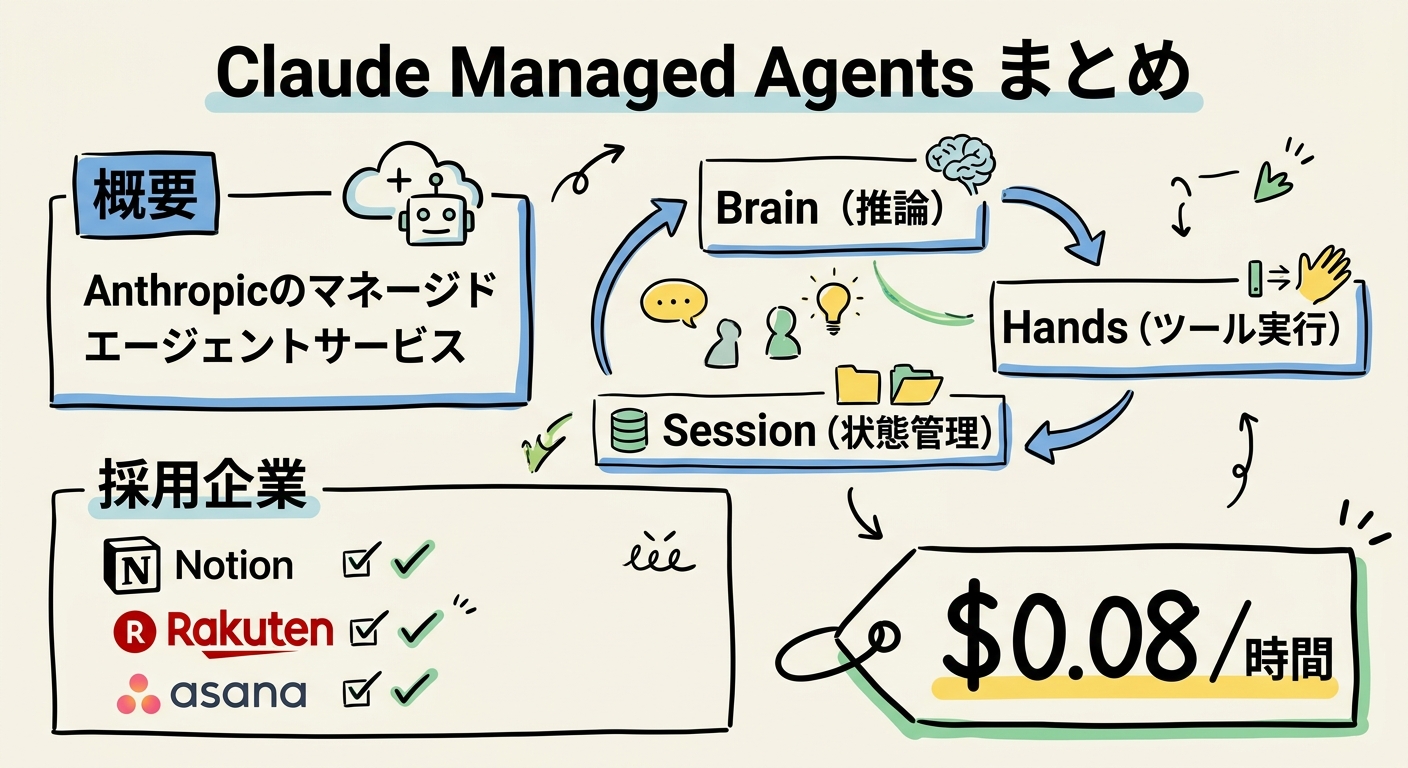

2026年4月8日、AnthropicはClaude Managed Agentsを公開ベータとしてリリースした。同日に公開されたエンジニアリングブログ「Scaling Managed Agents: Decoupling the brain from the hands」は2時間で200万インプレッションを超え、いいね数は39,000を突破した。AIインフラの世界では異例の反響だ。

何が「Managed」なのか

Claude Managed Agentsをひと言で説明すると、「クラウドホスト型AIエージェントをスケールで構築・デプロイするためのコンポーザブルAPIスイート」だ。

これまで開発者がAIエージェントを本番運用しようとすると、セッション管理、サンドボックス環境の構成、スケールアウト、モニタリングをすべて自前で実装する必要があった。Claude Managed Agentsはこれらをまるごと引き受ける。ホスティング、スケーリング、モニタリングはAnthropicが管理する完全マネージドサービスだ。

全AnthropicAPIアカウントがアクセス可能で、リクエストヘッダーにmanaged-agents-2026-04-01を指定するだけで利用を開始できる。

アーキテクチャの核心:BrainとHandsの分離

技術的に最も面白いのは、設計思想そのものだ。

エンジニアリングブログのタイトルにある「brain from the hands」というフレーズが示すように、Claude Managed Agentsは3つのコンポーネントを明確に切り離している。

**Brain(制御ループ)**はステートレスで動作する。思考と意思決定を担うが、状態を持たない。**Hands(サンドボックス実行環境)はツールコール時にのみプロビジョニングされるコンテナだ。Python、Node.js、Goに対応し、Anthropicがライフサイクル全体を管理する。そしてSession(永続イベントログ)**が2つを結ぶ接着剤として機能し、切断後でもチェックポイントから再開できる。

この設計の効果は数字に表れている。p50(中央値)のTime to First Token(TTFT)が約60%削減、p95(上位5%の遅延)では90%超の削減だ。Brainをステートレスにしたことでコールドスタートのオーバーヘッドが消え、Handsをオンデマンドでプロビジョニングすることでアイドル時のリソース消費がなくなる。理にかなった設計だと思う。

使える機能の範囲

公開ベータで利用できる機能は広範だ。

セッションは数時間規模の長時間実行に対応する。ビルトインツールとしてBashコマンド実行、ファイル操作、Webサーチ、MCPサーバー連携が提供される。エージェント定義は、モデル・システムプロンプト・ツール・MCP・スキルをIDで管理し、セッションをまたいで参照できる。サーバー送信イベント(SSE)によるリアルタイムストリーミング、認証、スコープ付きパーミッション、エンドツーエンドトレースも内蔵だ。

一方、マルチエージェント調整、メモリ、アウトカム評価の3機能は「Research Preview」扱いとなり、別途アクセス申請が必要だ。この3つが揃ってこそ本格的なエンタープライズ用途に耐えると筆者は感じるが、まずは土台の公開ということだろう。

価格構造

コスト設計はシンプルだ。

- セッション実行時間:$0.08/時間

- トークン:標準Claude APIレート

- Webサーチ:$10/1,000回(セッション内利用分)

長時間動かすエージェントには実行時間コストが積み上がるため、用途によってコスト計算が大きく変わる。単発タスクを高頻度で走らせるケースと、数時間のバッチ処理を定期実行するケースでは、同じ「エージェント」でも全く異なるコスト構造になる点は注意が必要だ。

誰が使っているのか

発表に合わせて3社のエンタープライズ採用事例が公開された。

Notionはワークスペース内でチームがClaudeにタスクを直接委任できる機能として統合している。Asanaは「AI Teammates」と呼ぶ機能で、プロジェクト内で人間と並走するAIエージェントを実現した。

そして冒頭で触れたRakutenだ。営業、マーケ、財経、HRの各部門向けエージェントをSlack/Teams連携で構築し、各エージェントを1週間以内でデプロイした。ここで「1週間以内」が可能になった理由が見えてくる。インフラの構築をAnthropicに任せることで、開発チームはエージェントのロジックと業務フローの設計だけに集中できたのだ。

競合との位置づけ

比較対象として挙がりやすいのはOpenAI Assistants APIとLangGraphだ。

OpenAI Assistants APIとはインフラ管理不要という点で似ている。ただし、Anthropicは安全性設計が内蔵されているという点を差別化軸として打ち出している。Constitutional AIを研究してきた会社としての本気のアピールだと思う。単なる差別化トークではない。

LangGraphはモデル非依存で細粒度の制御が得意だ。「どのモデルでも使えて、コントロールをフルに握りたい」開発者には今後もLangGraphが選ばれる場面は多いだろう。Claude Managed Agentsが刈り取るのは「速度と簡便さを優先するエンタープライズ」という層だ。「制御より速度」というAnthropicの割り切りは、ターゲット設定として正直で好感が持てる。

同日リリース:Claude Cowork GA

同日、Claude Coworkも一般提供(GA)が開始された。こちらは非エンジニア向けのタスク委任UIで、コードを書かずにClaudeにタスクを委任できる。

Managed AgentsがAPIレイヤー、Coworkがコンシューマーレイヤー——この2つを同日にリリースしたのはAnthropicの意図的な戦略だろう。「AIエージェントをビルドする側も使う側も、どちらにも対応する」というポジショニングだ。

何が変わるか

率直に言えば、まだ公開ベータだ。マルチエージェント調整とメモリが本番品質に達するまでは、複雑なワークフローへの本格適用は待ちになる。しかし土台の設計思想、すなわちBrainとHandsの分離、セッションの永続化、オンデマンドなコンテナプロビジョニングは、長く使われるインフラの骨格として説得力がある。

Rakutenの「1週間デプロイ」という事例が示すのは、技術的ハードルの低下ではなく、AIエージェントを「試せる速度」と「本番に耐える品質」が同時に成立しはじめたということだ。この変化はじわじわと企業のAI活用の地図を書き換えていく。