Anthropic「Mythos」がリークで発覚——Opusを超える新モデル「Capybara」の全貌とサイバーセキュリティへの衝撃

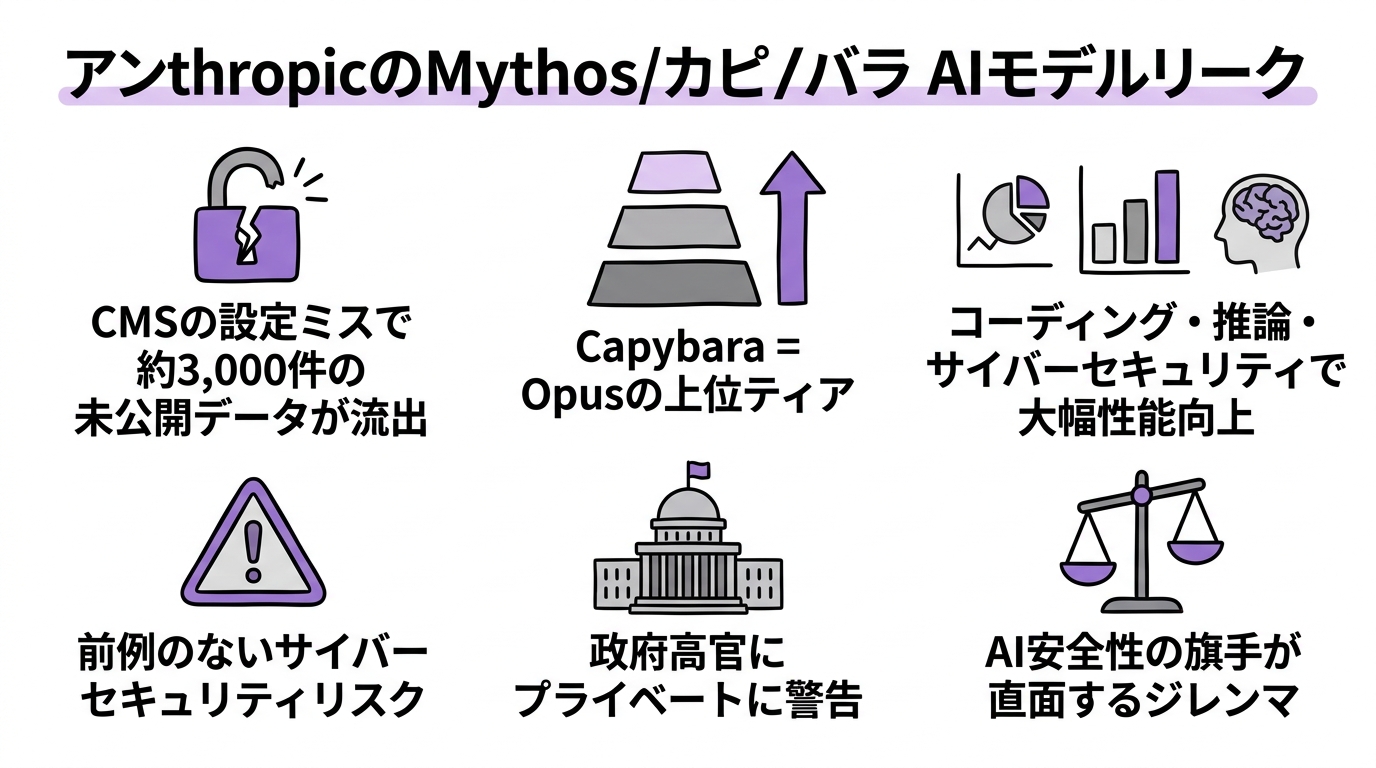

Anthropicが非公開で開発・テストしていた次世代AIモデルが、皮肉にもCMS(コンテンツ管理システム)の設定ミスによって世に出た。コードネーム「Mythos」、あるいは「Capybara」と呼ばれるこのモデルは、Anthropicが「ステップチェンジ」と表現するほどの性能向上を果たしている。問題は、その能力がサイバーセキュリティの脅威を劇的に高める可能性があることだ。

何が起きたのか

3月26日、Fortuneが独占スクープとして報じた。Anthropicのコンテンツ管理システムに含まれる約3,000件の未公開アセットが、セキュリティ設定の不備により公開状態になっていた。LayerX SecurityのRoy Paz氏とケンブリッジ大学のAlexandre Pauwels氏がこのデータストアを発見し、その中にはMythos/Capybaraに関するブログ記事の草稿が含まれていた。

Anthropicは指摘を受けて即座にアクセスを遮断し、「CMS設定におけるヒューマンエラー」が原因だと認めた。「公開を検討していた初期草稿」と説明したが、ここに大きな皮肉がある。AIの安全性を最重要テーマに掲げる企業が、自社のCMS設定という基本的なセキュリティで失態を犯したのだ。

Capybaraとは何か

リークされた文書によると、CapybaraはAnthropicの既存モデル階層において「Opus」の上位に位置する、まったく新しいティアだ。つまり、現行最強のClaude Opus 4.6を明確に上回るモデルが存在していることになる。

Opusとの比較で判明した性能差は以下の通りだ。

- ソフトウェアコーディング: 大幅にスコアが向上

- 学術的推論タスク: 顕著な性能改善

- サイバーセキュリティ関連タスク: 劇的な能力向上

「Capybara」と「Mythos」は同一のモデルを指していると見られている。Capybaraがモデルファミリーの名称、MythosがプロダクトまたはAPIでの公開名——という棲み分けになる可能性が高い。

サイバーセキュリティへの影響——「前例のないリスク」

リーク情報の中で最も衝撃的だったのは、Anthropic自身がMythosのサイバーセキュリティリスクを「前例のない(unprecedented)」と評価していたことだ。

具体的には、Mythosは以下の能力を持つとされている。

- ソフトウェアの脆弱性を高速で発見・悪用できる

- 大規模サイバー攻撃の実行を容易にする可能性がある

- サイバー軍拡競争を加速するリスクがある

Anthropicは政府高官にプライベートに警告を行っており、2026年中にMythosによって大規模サイバー攻撃の蓋然性が大幅に高まると伝えたとされている。AI企業が自社製品のリスクをここまで率直に政府に警告するのは異例のことだ。

率直に言えば、これは「AIの安全性」が抽象的な議論フェーズを完全に脱したことを示している。自社モデルのサイバーセキュリティリスクを公式に認め、政府に警告するという行動は、リスクの具体性が無視できないレベルに達したことの証左だ。

市場と業界への影響

リーク後の3月27日、関連銘柄が反応した。特にソフトウェアセキュリティ企業の株価は上昇し、逆に旧来型のサイバー防御ソリューションは売り圧力を受けた。ビットコインも連れ安となり、AIの脅威がデジタル資産全般のリスクプレミアムを引き上げた格好だ。

競合他社への示唆も大きい。OpenAIのGPT-5.4、GoogleのGemini 3.1が相次いでリリースされる中、Anthropicが「Opusの上位」というさらに強力なモデルを用意していたことは、AI性能競争がまだまだ天井に達していないことを意味する。

「安全性の旗手」が直面するジレンマ

Anthropicはスタートアップとしてのアイデンティティを「AI安全性」に賭けてきた。共同創業者のDario Amaodei氏は繰り返しResponsible Scaling Policyを掲げ、モデルの能力が閾値を超えた場合にリリースを制限する姿勢を示してきた。

しかし今回のリークは、2つの不都合な問いを突きつけている。

第一に、CMSの設定ミスという初歩的なセキュリティ問題は、AIの安全性を標榜する組織として受け入れがたい。 「AIモデルの安全性」と「組織のセキュリティ」は別問題とはいえ、信頼性の根幹に関わる。

第二に、「前例のないサイバーセキュリティリスク」を自覚しながら開発を継続する判断は、安全性優先の理念と矛盾しないのか。 Responsible Scaling Policyは、まさにこうした状況への対処を想定したフレームワークのはずだ。

Anthropicがこの問いにどう答えるかは、AI業界全体の安全性議論に影響を与えるだろう。

何が分かっていて、何が分かっていないか

分かっていること:

- CapybaraはOpusの上位ティアで、Mythosとして製品化される見通し

- コーディング・推論・サイバーセキュリティの各ベンチマークで大幅な性能向上

- Anthropicは限定的なアーリーアクセスで顧客テストを実施中

- サイバーセキュリティリスクについて政府に警告済み

分かっていないこと:

- 一般公開の時期と提供形態

- 具体的なベンチマークスコア(リーク文書は草稿段階)

- Responsible Scaling Policy上の評価結果

- 価格設定とAPI仕様

リークの皮肉な点は、Anthropicが自ら公表する予定だった情報が、意図せぬ形で——しかも「セキュリティの失態」という文脈付きで——世に出てしまったことだ。正式発表のナラティブは完全に崩れた。今後のAnthropicのコミュニケーション戦略が問われる局面だ。

Sources:

- Exclusive: Anthropic 'Mythos' AI model representing 'step change' in power revealed in data leak | Fortune

- Anthropic accidentally leaked details of a new AI model that poses unprecedented cybersecurity risks | Fortune

- What is Anthropic's Mythos? The leaked AI model that poses 'unprecedented' cybersecurity risks | Euronews

- Anthropic's massive 'Claude Mythos' leak sends software stocks crashing | CoinDesk

- Anthropic Just Leaked Upcoming Model With "Unprecedented Cybersecurity Risks" in the Most Ironic Way Possible | Futurism