MetaがNVIDIA依存から脱却へ——自社AIチップ「MTIA」4世代を2年で投入する狙い

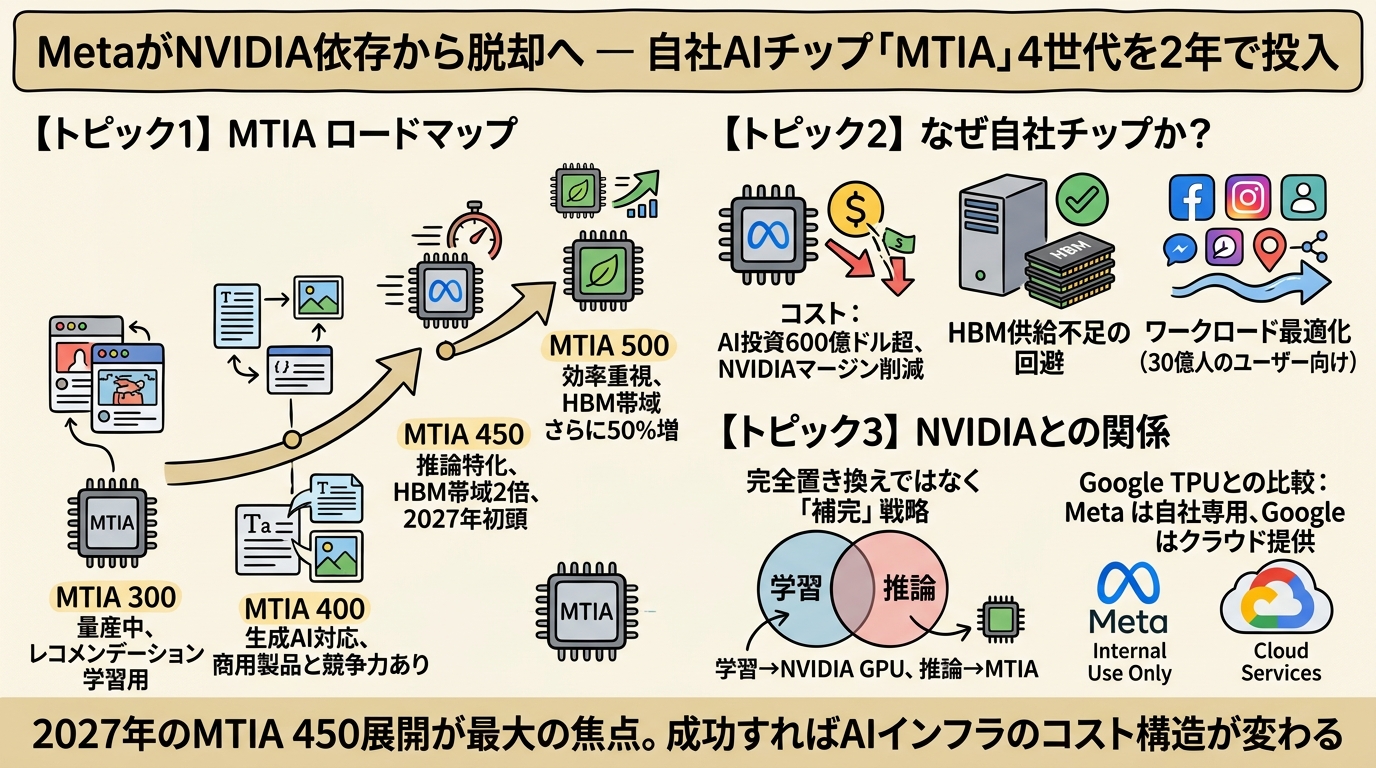

2026年3月11日、Metaは自社設計のAIアクセラレータ「MTIA(Meta Training and Inference Accelerator)」の新ロードマップを発表した。MTIA 300、400、450、500の4世代を2027年末までに展開するという、かなり攻めた計画だ。

NVIDIAのGPUに依存し続けてきたビッグテック各社の中で、Metaがここまで明確に「自前チップ路線」を打ち出したのは初めてのこと。率直に言えば、この動きはAI半導体市場の勢力図を変える可能性がある。

MTIA 4世代のスペックと投入時期

Metaが公開したロードマップを整理すると、各チップの位置づけが見えてくる。

MTIA 300はすでに量産段階にある。用途はランキングとレコメンデーションの学習で、FacebookやInstagramのフィード表示を支える基盤チップだ。派手なスペック競争に参加するのではなく、Metaの実サービスで日々動いている点が重要だろう。

MTIA 400は300の進化版で、生成AIワークロードにも対応する初のMTIAチップとなる。Metaはこのチップについて「主要な商用製品と競争力のある生の性能」と表現している。NVIDIAのA100やH100クラスを意識した発言と見るのが自然だ。

ここからが本番と言っていい。MTIA 450は生成AI推論に特化した設計で、HBM帯域幅をMTIA 400の2倍に拡張。Metaは「既存の主要商用製品をはるかに上回る性能」と強気の表現を使った。2027年初頭の大規模展開を予定している。

MTIA 500はさらにHBM帯域幅を450比で50%増加させた効率重視の推論チップ。同じく2027年中の展開が計画されている。

なぜMetaは自社チップに舵を切ったのか

背景には3つの要因がある。

1つ目はコストだ。Metaは2026年だけでAIインフラに600億ドル以上を投じる計画を公表している。NVIDIAのハイエンドGPUは1基あたり数万ドルで、数十万基単位の調達はキャッシュフローを圧迫する。自社チップならTSMCへの製造委託費用だけで済み、NVIDIAのマージン分を削減できる。

2つ目はHBM(高帯域幅メモリ)の供給不足。AI需要の急増でHBMはSK hynix、Samsung、Micronの3社に集中しており、調達競争が激化している。自社設計なら搭載量やアーキテクチャを柔軟に調整できるため、供給制約を回避しやすい。

3つ目は、個人的に最も大きいと思うのだが、ワークロードの最適化だ。汎用GPUは万能だが、Metaの推論ワークロードには無駄も多い。30億人以上のユーザーに対するレコメンデーションと生成AI推論という明確な用途があるなら、そこに絞った設計のほうが電力あたりの性能で勝る。

NVIDIAとの関係はどうなるのか

ここで気になるのは、MetaがNVIDIAと完全に手を切るのかという点だ。答えはノーだろう。

実際、Metaは2026年初頭にNVIDIAおよびAMDとの大型契約を締結したばかりだ。CNBCの報道によれば、MTIAチップの展開発表はこの契約締結のわずか数週間後。つまりMetaの戦略は「置き換え」ではなく「補完」にある。

学習(トレーニング)ワークロードには引き続きNVIDIA GPUを使い、推論ワークロードを徐々にMTIAへ移行する——これがMetaの現実的な落とし所だろう。NVIDIAの「Vera Rubin」プラットフォームが2027年に本格展開されることを考えると、学習側でもNVIDIAとの関係は当面続く。

Googleとの比較で見えるMetaの独自性

自社AIチップの開発ではGoogleが先行している。TPU(Tensor Processing Unit)は2015年から運用されており、すでに第6世代の「Trillium」が稼働中だ。

だが両社のアプローチは異なる。GoogleのTPUはクラウドサービス(Google Cloud)を通じて外部にも提供されているのに対し、MetaのMTIAは完全に自社利用専用。FacebookやInstagram、WhatsApp、Threadsといった自社プラットフォームの最適化だけに集中できるのは、クラウド事業を持たないMetaならではの強みだ。

もう一つの違いは開発ペースにある。Googleは数年単位でTPUの世代を更新してきたが、Metaは2年で4世代という異例の速さ。正直なところ、このペースを維持できるかには疑問も残る。だが「速く試して改善する」というMetaの企業文化がハードウェア開発にも適用されているのは興味深い。

AI半導体市場への波及効果

Metaの動きが示すのは、ビッグテックによる「脱NVIDIA」の流れが加速しているという事実だ。

AmazonはAWS向けにGravitonとTrainiumを展開し、MicrosoftはAzure向けにMaiaチップを開発中。Appleは以前からMシリーズチップでオンデバイスAIを推進している。NVIDIAのデータセンター向け売上は2025年度に470億ドルを超えたが、主要顧客が次々と自社チップに投資する状況は、長期的な市場シェアに影響しうる。

一方で、こうした自社チップ開発には膨大な初期投資とエンジニアリングリソースが必要だ。半導体設計の専門人材は世界的に不足しており、チップ1つのテープアウト(製造開始前の最終設計)には数億ドルかかることもある。中小規模のAI企業にとって、NVIDIAのGPUは依然として最も合理的な選択肢であり続ける。

今後の注目ポイント

MTIA 450と500が予定通り2027年に大規模展開できるかが最大の焦点になる。半導体の量産には歩留まりの問題がつきもので、設計通りの性能が出るかは実際にシリコンを回してみないとわからない。

もう一つ気になるのは、MetaがMTIAの成果をオープンソースコミュニティにどう還元するかだ。LLMではLlamaシリーズをオープンソースで公開してきた実績がある。チップの設計情報やソフトウェアスタック(コンパイラ、ランタイムなど)の公開に踏み切れば、AI半導体のエコシステム全体に影響を与えるだろう。

Metaの自社チップ路線は、AIインフラのコスト構造を変える試みだ。成功すれば、「AIを動かすコスト」そのものが下がり、より多くの企業や開発者がAIを活用できる環境が整う。2027年のMTIA 450展開を、注意深く見守りたい。

Sources:

- Four MTIA Chips in Two Years: Scaling AI Experiences for Billions | Meta AI

- Expanding Meta's Custom Silicon to Power Our AI Workloads | Meta

- Meta rolls out in-house AI chips weeks after massive Nvidia, AMD deals | CNBC

- Meta expands Nvidia deal to use millions of AI chips in data center build-out | CNBC

- Meta Outlines New MTIA Accelerator Roadmap for its Next-Gen AI Compute Mix | ServeTheHome